OpenClawのセキュリティリスク:エージェント型AIについてセキュリティチームが知っておくべきこと

新たに特定された脆弱性を理解し、AIを安全に導入するための予防戦略を

重要ポイント:

- OpenClawは、ファイルや認証情報、ワークフローを実際に操作できる権限を持つエージェント型AIに内在する本質的なセキュリティリスクを明らかにしています。

- 最近明らかになったOpenClawの脆弱性は、設定ミス、悪意のあるWebサイト、脆弱な信頼前提によって、AIエージェントが簡単に乗っ取られることを示しています。

- エージェント型AIは、信頼できない入力、サードパーティコード、永続メモリ、高権限の操作を組み合わせることで、攻撃対象領域を大きく拡大させます。

- 実際のリスクの多くはゼロデイ攻撃ではなく、特にインターネットへのエージェントの無防備な公開や過剰な権限が付与されたアイデンティティなど、不適切な展開方法に起因しています。

- リスクを低減するには、エージェントの分離、権限の制限、強力なガバナンスの適用が必要であり、エージェント型AIはデフォルトで「信頼できないコード」として扱わなければなりません。

OpenClawとは?

OpenClawは、ローカル環境でエージェント型AI(ツールを使って実際に作業を実行できるAI)を実行するためのオープンソースフレームワークであり、ファイル、ブラウザ、API、連携サービスへアクセスできます。

OpenClawの脆弱性が重大な理由:

セキュリティが不十分な環境では、攻撃者がエージェントを乗っ取り、エージェントの認証情報やツールへのアクセス権限を悪用して、データ窃取、ラテラルムーブメント、コマンド実行などを行う恐れがあります。

OpenClawのリスク概要:エージェント型AIによって脅威モデルが根本から変わる理由

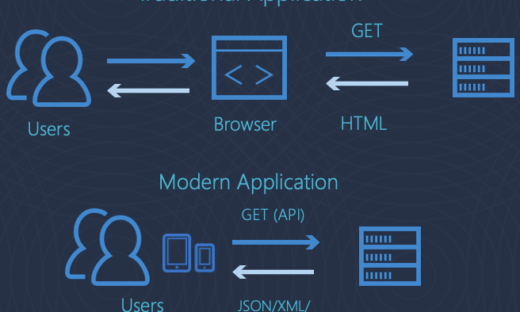

エージェント型AIは急速に進化しています。単にプロンプトに応答するだけでなく、実際の操作までを実行するツールが、すでに開発者のワークフローや企業のパイロットプロジェクトとして活用され、ファイルの読み取り、Web閲覧、コマンド実行、意思決定までを行っています。 OpenClawは、この変化を象徴する代表例の一つであり、驚異的なスピードで普及しています。 しかし、最近OpenClawで発生したセキュリティインシデントは、自律型エージェントに実際の権限を付与することで、イノベーションがセキュリティ対策を上回るリスクが顕在化する恐れがあることを示唆しています。

OpenClaw自体に悪意があるわけではありません。 OpenClawは、AIエージェントをローカルで実行するためのオープンソースフレームワークであり、ファイル、ブラウザ、API、連携するサービスへアクセス権を与えるように設計されています。 この能力は、AIエージェントに大きな力を与える一方で、 同時にリスクも伴います。ここ数か月で、研究者はさまざまな脆弱性やリスクが顕在するパターン(エクスポージャー)を明らかにしており、エージェント型AIがもたらすサイバーセキュリティ上の課題が浮き彫りになっています。

OpenClawの脆弱性とエクスポージャーパターン:現時点で分かっていること

ここ数か月で、いくつかの注目度の高い問題が特定されており、それらが組み合わさることでさらに重大なリスクとなることがわかってきました。

セキュリティチームは、デフォルト設定や単純な設定ミスにより、インターネットに公開されているOpenClawインスタンスが数万件規模で存在することを確認しました。これらのインスタンスは本来ローカルホストに限定されるべきでしたが、すべてのネットワークインターフェースにバインドされているケースが多く見られました。 多くの場合、インターネットに公開されたインスタンスは簡単に特定・アクセス可能であり、エージェントが利用するシステムや認証情報へ直接到達できる経路を提供していました。

ClawJackedは最も懸念されるバグの一つであり、ローカルで実行されているOpenClawエージェントを、悪意のあるWebサイトから密かに乗っ取ることが可能です。ローカルホストのWebSocket接続で前提とされている信頼を悪用することで、攻撃者は被害者のブラウザからブルートフォース攻撃によってゲートウェイの認証情報を取得し、エージェントを制御下に置き、管理者権限でコマンドを実行できます。 この攻撃では、プラグインや拡張機能、明確なユーザー操作は不要でした。

さらにリスクを増大させる要因として、サプライチェーン攻撃もいくつかの調査で確認されています。あるケースでは、改ざんされたnpmパッケージが、ユーザーの同意なしに開発者のマシンにOpenClawを密かにインストールされていました。OpenClaw自体はマルウェアではありませんが、不正に導入された場合には攻撃対象領域が拡大し、ユーザーは意図せず導入されたエージェントの保護責任を負うことになります。

加えて、根本的な問題として「エンタープライズ向けの一元的なキルスイッチが存在しない」点もいくつかのレポートで指摘されています。OpenClawのインスタンスは、多くの場合、開発者が個別に導入しているため、セキュリティチームがそれらを特定してインベントリを作成し、一括で停止することができません。

エージェント型AIが脅威を増幅させる理由

これらのインシデントは、単一のフレームワークの問題にとどまりません。 多くのエージェント型AIシステムに共通する構造的なリスクを浮き彫りにしています。

従来のソフトウェアとは異なり、エージェント型AIは、信頼できない入力、サードパーティコード、永続的なメモリ、高権限での実行を単一ループに統合しています。 つまり、エージェントは、悪意のあるWebページを読み取り、それを指示として解釈し、その指示を後で使うために保存し、さらに実行することができます。しかも多くの場合、正規の認証情報が使用されます。

Microsoftのセキュリティ研究者が指摘するように、OpenClawは永続的な認証情報を持つ、信頼できないコード実行として扱うべきです。分離が不十分な環境では、エージェントが侵害されると、そのままホストシステムおよびアクセス可能なすべてのリソースが侵害されることになります。

これは攻撃対象領域の劇的な拡大を意味することから、セキュリティに対する慎重かつ計画的な再設計が求められます。

イノベーションを止めずにリスクを低減する方法

OpenClawに関しては、基本的なセキュリティ対策が極めて重要です。 エージェントはインターネットに直接公開せず、非特権かつ専用の認証情報で実行し、常に最新のパッチを適用した状態で運用する必要があります。

さらに、デバイスの自動ペアリングやローカルホストの不十分な保護など、暗黙の信頼を前提とした機能は、利便性ではなくリスク要因として捉えるべきです。

エージェント型AIのセキュリティチェックリスト: エージェント型AIの導入を検討している組織は、セキュリティポスチャを強化しリスクを最小化するために、以下のような予防的対策を講じてください。

1.エージェントを徹底的に分離する: 専用の仮想マシンやコンテナ上でのみエージェント型AIを実行し、通常のワークステーションでは決して実行しないでください。

2.設計段階で権限を制限する: 必要最低限の権限のみを付与し、有効期限の短いトークンを使用し、機密システムへの常時アクセス権は付与しないでください。

3.プロンプトインジェクションは不可避と考える: Webコンテンツ、メール、メッセージなどの外部入力は、すべてデフォルトで悪意があるものとして扱います。

4.障害が発生することを前提に計画する: エージェントが永続的なメモリを持つ場合、監視、ログ取得、侵害時の再構築を前提とした運用が不可欠です。

5.エージェントを統制する: シャドーAIは重大なリスクです。 セキュリティチームは、エージェントが実行されている場所を把握できなければ、保護することはできません。

6.堅牢な入力検証を実装する: プロンプトインジェクションや不正操作を防ぐため、すべての入力を厳格に検証およびサニタイズします。

7.エージェントの活動を監視および監査する: エージェントによるすべての操作を包括的にログ記録し、不審な挙動がないかこれらのログを定期的に確認します。

8.従業員を教育してトレーニングする: エージェント型AIに伴うリスクを、すべてのユーザーと管理者が理解する必要があります。 安全な利用方法、侵害の兆候の見分け方、インシデント対応についてトレーニングを行ってください。

9.ゼロトラストのアプローチを導入する:エージェント型AIを過度に信頼せず、必要最小限のリソースにのみアクセスを制限します。

個人にとって重要なのはセキュリティ意識です。 エージェント型AIとやり取りする際は慎重に行動してください。個人情報や機密情報へのアクセスを許可する場合には、特に注意が必要です。 また、ベンダーに対しては、エージェントシステムにおけるセキュリティおよびプライバシー対応の透明性を求めることが重要です。

エージェント型AI時代における警戒

OpenClawのようなエージェント型AIフレームワークの急速な普及は、大きな可能性と同時に課題ももたらしています。 最近の脆弱性が示す通り、リスクが現実化しており、今後さらに拡大していく可能性があります。 警戒の文化を根付かせ、設計段階からセキュリティを重視し、リスクを低減する実践的な戦略を採用することで、組織や個人は脅威を抑えつつエージェント型AIを活用することができます。

原文はこちら:

OpenClaw security risks: What security teams need to know about agentic AI

Apr 9, 2026 Tony Burgess

https://blog.barracuda.com/2026/04/09/openclaw-security-risks-agentic-ai