セキュリティ予測 2026:自律型AIの世界における現実と制御をめぐる戦い

2025年11月17日、Tilly Travers

自律型AIが2026年のサイバー脅威と防御をどう変革するか

要点

- 自律型AIが脅威環境の進化に与える影響

- 組織が自律型AI脅威に対抗する方法

- 自律型AI実装を保護する戦略

- 自律型AIがセキュリティ強化に果たす役割

適応性・自動化・自律性を備えた自律型AIの力と可能性は、2025年のセキュリティ議論を席巻しました。バラクーダは世界各国のサイバー脅威・セキュリティ分野を率いる4名の社員に、2026年の自律型AIへの展望とサイバーセキュリティへの影響を尋ねた。

彼らが予測する未来像は以下の通り:

- エージェント型AIオペレーターがサイバー攻撃をエンドツーエンドで実行。必要な情報を収集し、説得力のある罠を仕掛け、攻撃経路を試行。標的の防御システムの反応を観察し、目的達成まで静かに戦術とタイミングを調整する。防御側は、これまでに見たことのない新たな攻撃手法や戦術に直面し、事後説明が困難なケースも想定すべき。(Yaz Bekkar)

- エージェント型AIは膨大なデータを分析し、リアルタイムで脆弱性を特定。攻撃者は弱点をより効果的に悪用する手法を自動化できるようになる。(Jesus Cordero-Guzman)

- AIは音声・メッセージ双方で人間と対話し、相手が実在の人物ではないと気づくことがほぼ不可能なレベルに達する。(Eric Russo)

- 複数のAIエージェントが人間の監督を最小限または全く受けずに連携し、特定の目標達成に向けた行動を実行する。これにより、攻撃者が制御する情報を利用して協調行動を操作し、エージェント間の相互作用を乗っ取ったり汚染したりする可能性が生じる。人間の関与が欠如しているため、検知と緩和が遅れる恐れがある。(Rohit Aradhya)

- サイバーセキュリティのリーダーシップは、人間だけでなくAIエージェントの指揮も担うことになる。次世代の管理者は、生産性と意思決定を向上させるために、AIエージェントをチームに組み込み管理する方法を学ぶ必要がある。(Jesus Cordero-Guzman)

エージェント型AIは、2026年以降の脅威環境の進化にどのような意味を持つのか?

Yaz Bekkar、XDR主任コンサルティングアーキテクト、EMEA担当:来年までに、攻撃は単にAIを利用するだけでなく、AI自体が独立したオペレーターのように振る舞い、攻撃目標達成のためにリアルタイムで選択を行うようになる可能性があります。既にAIが偵察、フィッシング、基本的な防御回避といったキルチェーンの一部を自動化している事例が見られます。2026年の転換点は、ステップを計画し、防御からリアルタイムで学習し、人間の指示なしに経路を変更するシステムへの移行だと考えます。

AIオペレーターはエンドツーエンドで指揮を執り、必要な情報を収集し、説得力のある餌を仕掛け、経路を試行し、防御システムの反応を観察した後、目的達成まで静かに戦術とタイミングを調整します。これらの高度なハッキングツールは、各ステップを連携させ、障害から学習し、通常の活動に溶け込む協調的な頭脳のように感じられるでしょう。

防御側は、これまでに見たこともない新たな攻撃手法や戦術を想定すべきです。事後説明が困難なケースも発生するはずです。攻撃対象領域は拡大を続け、既知・未知の脆弱性が同時に生み出され、ゼロデイ攻撃が増加します。

Eric Russo、SOC防御セキュリティ部門ディレクター:AIは急速に進化し、音声とメッセージの両方で人間と会話できるレベルに達しました。その精度は、相手が人間ではないと気づくことがほぼ不可能なほどです。例えばAndroidユーザーは、GoogleのAI機能を活用して不明な番号からの電話に応答し、質問を投げかけ、会話を交わし、その通話の正当性を判断できるようになりました。この技術は非常に印象的ですが、脅威アクターが同じ技術を利用すると想像してみましょう。

エージェント型AIは従来の攻撃手法を変革する可能性があります。例えばソーシャルエンジニアリング攻撃で財務チームメンバーを標的にし、企業の銀行口座番号を入手するケースが考えられます。あるいは、ディープフェイクによるなりすましでヘルプデスク管理者を欺きMFAをリセットさせ、脅威アクターにITシステムへのアクセス権を与え、より精巧な攻撃を展開させるといった複雑な目的も想定されます。

Jesus Cordero-Guzman、EMEA地域 アプリケーション・ネットワークセキュリティ・XDRソリューションアーキテクト部門ディレクター:自律型AIは既に現実のものとなっており、脅威としても急速に進化する。膨大なデータを分析してリアルタイムで脆弱性を特定できるため、攻撃者は弱点をより効果的に悪用する手法を自動化できます。サイバー犯罪を促進するために一から設計された専用自律型AIプラットフォーム「Xanthorox」が登場したのは2025年初頭です。他にもHexStrikeやさらに高度なVenice.AIが存在します。エージェント型AIは自動化されたフィッシング攻撃、防御システムのリアルタイム監視、さらには不正アクセスを得るためのCAPTCHA解読能力すら武器化される可能性があります。

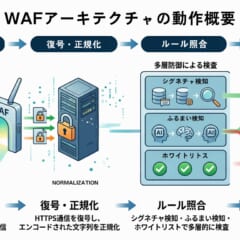

Rohit Aradhya、アプリセキュリティエンジニアリング担当副社長兼マネージングディレクター:エージェント型AIの進化は、適応型ポリモーフィックマルウェアの増加を招くでしょう。これは被害者の環境やセキュリティツールを分析し、自らのコードや動作を自律的に書き換えたり変更したりして、シグネチャベースや行動ベースの防御をリアルタイムで回避するマルウェアです。

特定の目標達成に向け、最小限または全く人間の監視なしに複数のエージェントが連携して行動する事例が増加します。これにより、攻撃者が制御する情報を利用して協調行動を操作し、エージェント間の相互作用を乗っ取る(ハイジャック)または汚染する(ポイズニング)可能性が生じます。人間の介入が欠如することで、検知と緩和が遅延する恐れがあります。

公開アプリケーションプログラミングインターフェース(API)、APIゲートウェイ、エージェント型サービスAPI、チャットボットベースのユーザーインターフェースの悪用も大幅に増加します。エージェント型ツールがサービス提供・消費のためにエージェント間およびユーザーとのAPIインターフェースを動的に生成・破棄するため、APIライフサイクル管理において動的API処理への対応が極めて重要となります。

組織はエージェント型AIベースの脅威からどのように防御し、自社のエージェント型AIシステムを保護すべきか?

Yaz Bekkar 大半の企業はエージェント型AIの到来を予見できないでしょう。これはシュレディンガーの猫に似ている:IT環境は「安全」と「侵害された」状態を同時に感じさせ、防御側に明確な手がかりを与えないでしょう。

唯一の現実的な防御策は、環境に合わせて調整されたAIによる行動(振る舞い)駆動型検知である。デフォルト設定のまま放置し「うまくいくことを願う」ツール購入では不十分だ。適切なソリューションを選択し、適切に実装し、継続的に改善せよ。真のレジリエンスは「強力な技術」と「それを日々運用する高水準の専門性」の融合から生まれます。

組織はサイロ化された単体ツールから脱却し、真のエンドツーエンド可視性を備えたプラットフォームへ移行する必要があります。これにはID管理、エンドポイント、SaaS、クラウド、メール、ネットワークトラフィックが含まれます。さらに、組織固有の「正常な状態」を学習し、シグネチャ待ちなしで異常やゼロデイ攻撃パターンを検知できる行動ベースのAI分析技術も不可欠です。人的判断のループを常に維持する必要があります。

Jesus Cordero-Guzman 従来の防御メカニズムは、AI駆動型脅威の速度と適応性に追いつけない可能性があります。組織は脅威の検知と対応にAIを組み込んだ先進的なセキュリティソリューションに投資し、進化する脅威に効果的に対処できる体制を整える必要があります。

組織は自律型AI実装を保護するために何をすべきか?

Jesus Cordero-Guzman サイバーセキュリティリーダーシップとは、人間だけでなくAIエージェントを率いることでもあります。次世代の管理者は、AIエージェントをチームの一員として組み込み、生産性と意思決定を向上させるために管理する方法を学ぶ必要があります。

組織のビジネスモデルに必要な「特性」をAIエージェントに付与するには、技術的熟練度、自然言語処理、データ分析に関するさらなる知見が求められます。これは単なる運用上の課題ではなく倫理的課題でもあります。統合されたAIエージェントが責任を持って使用され、これらのシステムによる意思決定が組織の価値観や社会的規範に沿うことを保証する必要があります。AIが進化を続ける中、サイバーセキュリティのこの動的な環境を導くリーダーシップの役割もまた進化し続けるでしょう。

Rohit Aradhya 組織がエージェント型AIの導入を開始するにつれ、AIに特化した一連のセキュリティ対策が必要となります。これにはAIエージェント向けの堅牢なID・アクセス管理(IAM)が含まれます。各エージェントは関連ユーザー、グループ、リソースアクセス権限を持つ独立したエンティティとして扱われるべきです。組織はゼロトラストフレームワークをAIエージェントとツールに拡張し、過去の行動にかかわらずエージェントが試みるあらゆる要求と行動を検証・妥当性確認する必要があります。システムの運用行動の監視に注力し、逸脱を迅速に検知する必要があります。エージェント間通信は、追跡可能性と説明可能性を確保し、通信を妨害する攻撃から保護するため、適切に認証・暗号化・記録され、セキュリティ対策が施されなければなりません。最後に、NIST AIリスク管理フレームワークなどの基準を理解し遵守することも重要です。

リスクを超えて、エージェント型AIはセキュリティ強化にどう貢献するのか?

Eric Russo:エージェント型AIはSOCチームにとって強力なツールとなります。SOCチームが担う反応的業務の負担を軽減し、脅威研究や検知エンジニアリングなど、より積極的なセキュリティ施策へのリソース配分を可能にする機会を提供します。例えば、セキュリティシステムの管理業務に関連する多くのタスクはエージェント型AIで処理できます。従来、SOCアナリストやエンジニアが手動でそのタスクを完了するのに必要だった時間を、代わりにその個人が新たな脅威に集中できるようにします。

セキュリティ防御におけるAIのもう一つのユースケースは、脅威検出における機械学習の拡張です。従来の検知メカニズムは本質的に静的である。しかし、ユーザー行動やネットワークトラフィックなどのベースラインを確立し、異常スコアリングの基準を定義してシステムがセキュリティアラートを発するタイミングを判断する機械学習アルゴリズムを構築することは、高度な脅威アクターを検知する非常に効果的なアプローチである。この手法は信頼性の高いアラート生成という利点もあり、アラート疲労や誤検知を低減します。

e-book: The role of AI in cybersecurity(サイバーセキュリティにおけるAIの役割ガイド)